Biologien bag forstærkningsindlæring kan findes på Operant konditionering og Belønning

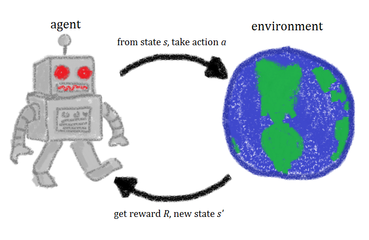

Reinforcement learning (RL) er at lære en softwareagent, hvordan den skal opføre sig i et miljø ved at fortælle den, hvor godt den klarer sig. Det er et område inden for maskinindlæring, der er inspireret af adfærdspsykologi.

Forstærket indlæring adskiller sig fra overvåget indlæring, fordi de korrekte input og output aldrig bliver vist. Desuden lærer forstærkende læring normalt undervejs (online-læring) i modsætning til superviseret læring. Det betyder, at en agent skal vælge mellem at udforske og holde sig til det, den kender bedst.

Grundprincipper og nøglebegreber

- Agent: Den lærende enhed, som træffer handlinger.

- Miljø: Alt det, agenten interagerer med; det giver observationer og belønninger.

- Tilstand (state): En beskrivelse af miljøets aktuelle situation set fra agentens perspektiv.

- Handling (action): Et valg agenten foretager i en given tilstand.

- Belønning (reward): Et signal fra miljøet, som fortæller agenten, hvor god en handling var i forhold til målet.

- Politik (policy): En strategi, der beskriver, hvordan agenten vælger handlinger fra tilstande (kan være deterministisk eller stokastisk).

- Værdi-funktion (value): Estimat af, hvor god en tilstand eller handling er i forventet fremtidig belønning (f.eks. V(s) eller Q(s,a)).

- Return og diskonteringsfaktor (gamma): Samlet fremtidig belønning; gamma bruges til at vægte nærmeste belønninger højere end fjerne.

Udfordringen: udforskning vs. udnyttelse

Et centralt problem i RL er exploration vs. exploitation: agenten skal afveje at prøve nye handlinger for at lære mere (udforskning) mod at bruge den viden, den allerede har, for at få høj belønning (udnyttelse). Almindelige strategier inkluderer epsilon-greedy, softmax og mere avancerede metoder som Upper Confidence Bound eller Bayesian approaches.

Typer af metoder

Man skelner ofte mellem:

- Model-free: Agenten lærer direkte en politik eller værdi-funktion uden at forsøge at modellere miljøets dynamik (f.eks. Q-learning, SARSA, Policy Gradient).

- Model-based: Agenten bygger eller lærer en model af miljøet og planlægger herefter (kan være mere sample-effektiv, men kræver en god model).

- Dyb forstærkning (Deep RL): Kombination af RL-algoritmer med dybe neurale netværk som funktionstilnærmere (f.eks. DQN, DDPG, PPO), hvilket muliggør håndtering af store, komplekse tilstandsrum.

Almindelige algoritmer

- Q-learning: En off-policy værdibaseret metode til at lære Q(s,a).

- SARSA: En on-policy værdibaseret metode.

- DQN (Deep Q-Network): Bruger neurale netværk til at approksimere Q-funktionen; kendt fra spil som Atari.

- Policy Gradient / REINFORCE: Lærer politikken direkte ved at optimere forventet return.

- Actor-Critic: Kombinerer en aktør (policy) og en kritiker (value-estimat) for mere stabil læring.

- Proximal Policy Optimization (PPO) og Trust Region Policy Optimization (TRPO): Moderne, stabile policy-optimiseringsmetoder.

Anvendelser

- Spil (fra klassiske bræt- og computerspil til komplekse realtids-spil).

- Robotik (bevægelseskontrol, manipulation, navigation).

- Autonome køretøjer og droner.

- Optimering i industrien (f.eks. styring af energiforbrug, logistik).

- Finansielle strategier og anbefalingssystemer.

- Simulerede miljøer for forskning og træning, hvor sikker eksperimentering er nødvendig.

Udfordringer og bedste praksis

- Prøveeffektivitet: RL kræver ofte mange prøver/interaktioner; simulering og transfer learning bruges ofte til at reducere omkostninger.

- Sparse belønninger: Når belønninger er sjældne, kan agenten have svært ved at finde meningsfuld læring uden reward shaping eller curriculum learning.

- Kredittildeling: At finde ud af hvilke handlinger i fortiden der førte til en fremtidig belønning kan være svært.

- Stabilitet og konvergens: Funktionstilnærmelse med neurale netværk kan gøre træningen ustabil; teknikker som replay buffers, target networks og fordelbaserede estimater hjælper.

- Sikkerhed og etik: I virkelige anvendelser er det væsentligt at sikre, at agentens adfærd er sikker, pålidelig og ikke udnytter utilsigtede måder at opnå belønning på.

Relation til biologien

Som indledningen antyder, har forstærkningslæring stærke paralleller til biologiske læringsmekanismer som Operant konditionering og Belønning. Neurovidenskabelige studier peger på dopamins rolle i belønningssignalering og midlertidig kodning af forventede værdier, hvilket inspirerer både teorier og algoritmer inden for RL.

Afsluttende bemærkninger

Forstærkningslæring er et kraftfuldt værktøj til at løse sekventielle beslutningsproblemer, især når målet kan formuleres som optimering af langsigtet belønning. Samtidig kræver succesfuld anvendelse forståelse for problemformulering, valg af algoritme, simulering versus real-world træning samt omtanke omkring sikkerhed og etik.