Lineær regression er en måde at se på, hvordan noget ændrer sig, når andre ting ændrer sig, ved hjælp af matematik. En lineær regression bruger en afhængig variabel og en eller flere forklarende variabler til at skabe en lige linje. Denne lige linje er kendt som en "regressionslinje".

Lineær regression var den første af mange måder at udføre regressionsanalyse på. Det skyldes, at modeller, der afhænger lineært af deres ukendte parametre, er lettere at tilpasse end modeller, der er ikke-lineært relateret til deres parametre. En anden fordel ved lineær regression er, at de statistiske egenskaber ved de resulterende estimatorer er lettere at bestemme.

Lineær regression har mange praktiske anvendelsesmuligheder. De fleste anvendelser falder ind under en af følgende to brede kategorier:

- Lineær regression kan bruges til at tilpasse en forudsigelsesmodel til et sæt observerede værdier (data). Dette er nyttigt, hvis målet er forudsigelse, prognose eller reduktion. Hvis der efter udviklingen af en sådan model gives en yderligere værdi af X uden den tilhørende værdi af y, kan den tilpassede model anvendes til at lave en forudsagt værdi af y (skrevet som

- Med en variabel y og en række variabler X1 , ..., Xp , der kan være relateret til y, kan lineær regressionsanalyse anvendes til at kvantificere styrken af forholdet mellem y og Xj , til at vurdere, hvilken Xj der slet ikke har nogen sammenhæng med y, og til at identificere, hvilke delmængder af Xj der indeholder overflødige oplysninger om y.

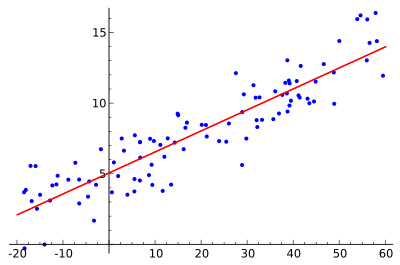

Lineære regressionsmodeller forsøger at gøre den lodrette afstand mellem linjen og datapunkterne (dvs. residualerne) så lille som muligt. Dette kaldes "tilpasning af linjen til dataene". Ofte forsøger lineære regressionsmodeller at minimere summen af residualernes kvadrater (mindste kvadrater), men der findes også andre måder at tilpasse på. De omfatter minimering af "manglende tilpasning" i en anden norm (som ved regression med mindste absolutte afvigelser) eller minimering af en straffet version af tabsfunktionen for mindste kvadrater som ved ridge-regression. Den mindste kvadraters metode kan også bruges til at tilpasse modeller, der ikke er lineære. Som skitseret ovenfor er udtrykkene "mindste kvadraters" og "lineær model" tæt forbundet, men de er ikke synonymer.

Grundlæggende model og fortolkning

Den simpleste lineære regressionsmodel (en variabel) kan skrives som:

y = β0 + β1 x + ε

Her er β0 (interceptet) og β1 (hældningskoefficienten) parametre, der skal estimeres, og ε er en fejlterm, som opsummerer alle ikke-observerede påvirkninger. Fortolkningen af β1 er: ændringen i den forventede værdi af y ved en enheds ændring i x, når øvrige faktorer holdes konstante.

Mindste kvadraters metode (OLS)

Mindste kvadraters metode (ordinary least squares, OLS) estimerer parametrene ved at minimere summen af kvadrerede residualer:

Minimer Σ(yi − ŷi)². For simpel lineær regression fås de lukkede formler:

- β1 = sum((xi − x̄)*(yi − ȳ)) / sum((xi − x̄)²)

- β0 = ȳ − β1 * x̄

Disse estimatorer er nemme at beregne og har under visse betingelser gode statistiske egenskaber (fx er de BLUE — Best Linear Unbiased Estimators — under Gauss–Markov-betingelserne).

Antagelser (vigtige at kende)

For at OLS-estimaterne og de statistiske tests er pålidelige, antager man normalt:

- Lineæritet: Forholdet mellem forventet y og X er lineært i parametrene.

- Uafhængighed: Observationerne er uafhængige (ingen autokorrelation).

- Homoscedasticitet: Variansen af fejlene ε er konstant for alle værdier af X.

- Ingen perfekt multikolinearitet: I multivariat regression må forklarende variabler ikke være perfekte lineære kombinationer af hinanden.

- Fejlens middelværdi: E(ε | X) = 0 (ingen systematisk bias).

- Normalfordelte fejl (valgfrit): Hvis fejlene er normalfordelte, kan man bruge t- og F-tests og konstruere præcise konfidensintervaller ved små stikprøver.

Modelvurdering og diagnostik

Når en model er estimeret, er det vigtigt at kontrollere om antagelserne holder og vurdere modellens egnethed:

- R² og justeret R²: Angiver hvor stor en andel af variationen i y modellen forklarer. Justeret R² tager hensyn til antallet af variabler.

- Residualplot: Plot af residualer mod forudsagte værdier kan afsløre ikke-lineæritet eller heteroscedasticitet.

- Tests for heteroscedasticitet: fx Breusch–Pagan test eller White test.

- Autokorrelation: Durbin–Watson test er almindelig ved tidsseriedata.

- Multikolinearitet: Variance inflation factor (VIF) måler hvor stærkt forklarende variabler hænger sammen.

- Leverage og indflydelse: Punkter med høj leverage eller stor indflydelse (fx målt ved Cook’s distance) kan skævvride estimaterne.

Statistisk inferens

Ved OLS estimeres standardfejl for koefficienterne, hvilket gør det muligt at udføre t-tests (test af om en koefficient er forskellig fra nul), danne konfidensintervaller og udføre F-tests (fx om en gruppe af koefficienter er nul). Der skelnes mellem parameterestimaters præcision og modellens forklaringskraft.

Udvidelser og alternative metoder

- Multiple regression: Flere forklarende variabler (X1, X2, ...). Kan inkludere interaktionseffekter og polynomielle termer for at modellere ikke-lineariteter.

- Dummyvariabler: Bruges til at inddrage kategoriske variable (fx køn, region) i lineære modeller.

- Regulariserede metoder: Ridge (L2) og Lasso (L1) til at håndtere multikolinearitet og overfitting ved at indføre straftermer.

- Robuste regressionsmetoder: Mindsker påvirkning fra outliers (fx M-estimatorer, quantile regression).

- Generaliserede lineære modeller (GLM): Udvider tanken om linearitet til Situationen med ikke-normale responsvariable (fx logit/poisson).

Anvendelseseksempler

- Forudsigelse af huspriser ud fra størrelse, beliggenhed og antal værelser.

- Estimering af efterspørgsel (kvantitet) ud fra pris og indkomst.

- Analyse af sammenhængen mellem uddannelse og løn.

- Tidsserieanalyse af økonomiske variabler (med passende håndtering af autokorrelation).

Begrænsninger og faldgruber

Lineær regression er enkel og kraftfuld, men kan give misvisende resultater hvis:

- Modelen er forkert specificeret: Udeladte variabler eller forkert funktionel form kan føre til bias (fx omitted variable bias).

- Extrapolation: Forudsigelser uden for observationsområdet kan være ukorrekte.

- Endogenitet: Hvis nogle forklarende variabler korrelerer med fejlen (fx pga. simultanitet eller målefejl), bliver OLS-biasseret.

- Outliers og indflydelsesrige observationer: Kan trække regressionslinjen og give misvisende konklusioner.

Praktiske råd

- Start med simpel modelbygning og forstå hver koefficients fortolkning.

- Undersøg data visuelt (scatterplots, residualplots) før og efter estimering.

- Kør diagnostiske tests for heteroscedasticitet, autokorrelation og multikolinearitet.

- Overvej regularisering ved mange forklarende variable eller begrænset datastørrelse.

- Brug domæneviden til at vælge relevante variable og tolke resultater kritisk.

Værktøjer

Lineær regression implementeres bredt i statistik- og datalogi-software: fx i R (funktion lm()), Python (pakker som statsmodels og scikit-learn), Stata, SAS og Excel.

Samlet set er lineær regression et fundamentalt værktøj til både forudsigelse og forklaring. Dets enkelhed gør det let at anvende og tolke, men brugeren bør være opmærksom på antagelserne og potentielle kilder til bias for at sikre pålidelige konklusioner.